連載「AI初心者のための教科書」第9回/全10回

こんにちは、apro-incの業務改善・DXコンサルタント、AYAKAです。

2023年、アメリカのある弁護士がChatGPTを使って法的リサーチを行い、AIが生成した「架空の判例」を証拠として裁判所に提出しました。もちろんその判例は実在せず、弁護士は懲戒処分を受けました。

AIが事実に反する情報を、まるで事実であるかのように自信満々で出力する。この現象を「ハルシネーション(幻覚)」と呼びます。連載も第9回、今回はAIを安全に使うために経営者が必ず知っておくべき「AIの弱点」を正面から解説します。

ハルシネーションとは何か 「嘘」ではなく「構造的な錯覚」

AIは意図的に嘘をついているわけではありません。AIが間違える本当の理由は、その仕組み自体にあります。

生成AIは「真偽を判断するシステム」ではなく、「統計的に次に来る確率が高い単語をつなぎ合わせる機械」です。つまりAIは情報の正しさではなく「文章としての自然さ・もっともらしさ」を優先して回答を生成します。

その結果、学習データにない事柄を聞かれた場合でも、「知らない」と答えるのではなく、内部の知識の断片を組み合わせて「それらしい回答」を作り上げてしまうのです。これがハルシネーションの正体です。

厄介な理由:「もっともらしい」から見抜けない

ハルシネーションが特に危険なのは、その「見た目の正確さ」にあります。

- 文法的に正しい

- 専門用語を適切に使っている

- 論理的な流れになっている

- 自信を持って断言している

これらが組み合わさるため、その分野に詳しくない人が読んでも違和感がありません。特に数値・人名・法律・医療・統計データなどは、AIが「それらしい数字や名前」を作り出してしまう危険があります。

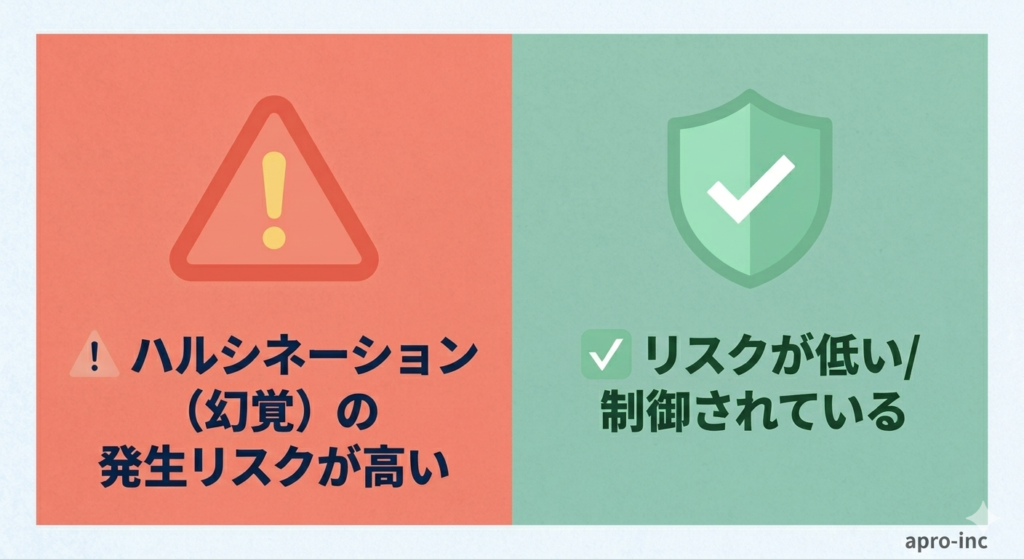

どんな場面で起きやすいか? リスクマップ

すべての質問でハルシネーションが起きるわけではありません。場面によってリスクは大きく異なります。

| ⚠️ ハルシネーションが起きやすい場面 | ✅ 起きにくい・抑制できる場面 |

|---|---|

| 最新情報・直近のニュースを聞く | 文章の作成・要約・翻訳・校正 |

| 実在する人物・企業の詳細情報 | 一般的な知識の説明・解説 |

| 統計データ・数値の正確な引用 | アイデア出し・ブレスト・企画の叩き台 |

| 法律・医療・税務など専門領域 | プロンプトで「出典を明示して」と指示したとき |

| 「〇〇について教えて」と漠然と聞く | 情報源を渡して「この文書を要約して」と聞く |

右列(✅)のように「情報源を渡した上で質問する」「文章の生成・要約に使う」という使い方は比較的安全です。一方、左列(⚠️)のような「最新情報・数値・専門知識を聞く」場面は特に注意が必要です。

2026年現在の最新状況:改善は進んでいるが「ゼロ」ではない

技術の進歩により、ハルシネーションの発生率は着実に低下しています。2026年3月リリースのGPT-5.3 Instantは、前バージョン比でハルシネーションを最大26.8%低減したことが確認されています。

ただし、最新モデルでも「完全にゼロ」にはなっていません。むしろ「改善されているからこそ過信しやすい」という新たなリスクが生まれています。モデルへの信頼が上がるほど、チェックが甘くなりやすいのです。

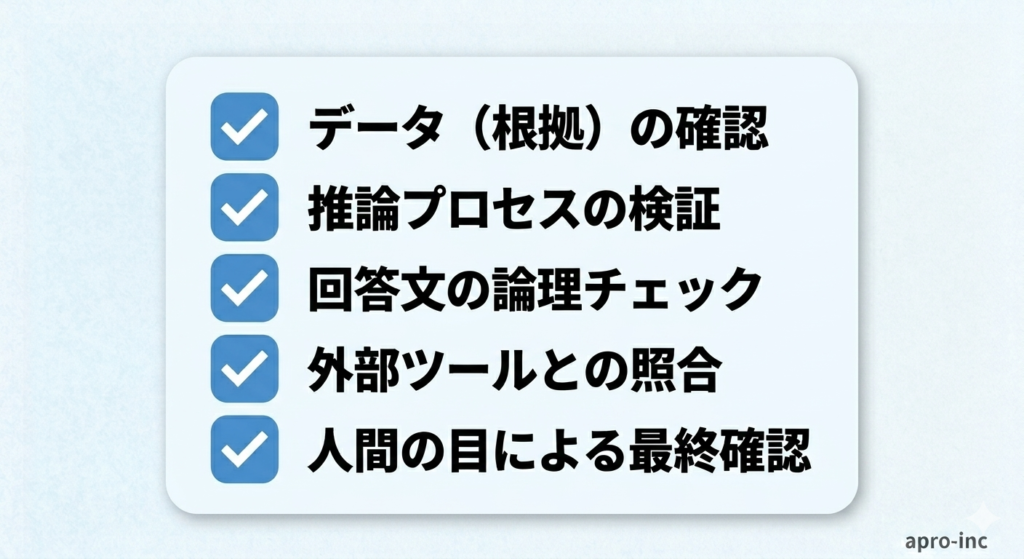

今日から実践:ハルシネーション対策5つのチェックリスト

ハルシネーションは完全には防げませんが、適切な運用で「実務上問題のないレベル」に抑えることは十分可能です。以下の5つを社内ルールとして徹底してください。

| 対策 | 具体的な方法 |

|---|---|

| 送信前に必ず人間がチェック | AIの出力をそのまま送付・掲載しない。特に数値・固有名詞・引用は原典と照合 |

| 出典付きで答えさせる | 「根拠となる情報源を明記して」とプロンプトに入れる。ソース不明の回答は疑う |

| 不明なら「わからない」と言わせる | 「知らない場合は『わかりません』と答えてください」と明示する |

| 情報源を渡して質問する | 「この文書をもとに」「以下のデータに基づいて」と資料を貼り付けて質問する |

| 重要判断にAI単独を使わない | 法務・税務・医療・投資判断は専門家の確認を必ず挟む。AIはあくまで補助 |

中小企業が特に注意すべき3つのシーン

① 契約書・法的文書への引用

「この条文は法律上問題ないか」「この契約書の内容を確認して」という使い方は危険です。AIが架空の法条文や判例を引用することがあります。法務は必ず専門家に確認してください。

② 数字・統計データの使用

「業界の平均成長率は?」「競合他社の売上は?」といった数値をAIに聞いて、そのまま資料に使うのはリスクがあります。数値は必ず一次情報源で確認してください。

③ 人物・企業への言及

実在する人物や企業の経歴・発言・事件についての回答は、架空の情報が混入しやすいです。社外に公開する文書でのAI生成情報の使用には特に慎重になってください。

AYAKA’s View

「AIが間違えることがある」と知ることは、AIを使うなということではありません。包丁が危険だからといって台所に置かないわけではないのと同じです。

大切なのは「AIはアシスタントであり、最終責任者は人間である」という認識を持ち続けること。AIが作った下書きを確認する30秒が、信頼を守る最大の投資です。

最終回の第10回は「中小企業がAIで勝つための3年ロードマップ」。この連載の総まとめとして、実際の経営判断に使えるロードマップをお届けします!

【お問い合わせはこちら|業務改善・DXのご相談】 https://apro-inc.biz/contact/